Про це, як пише видання Jane’s, говориться в новій доповіді Комітету з юридичних питань Європейського парламенту.

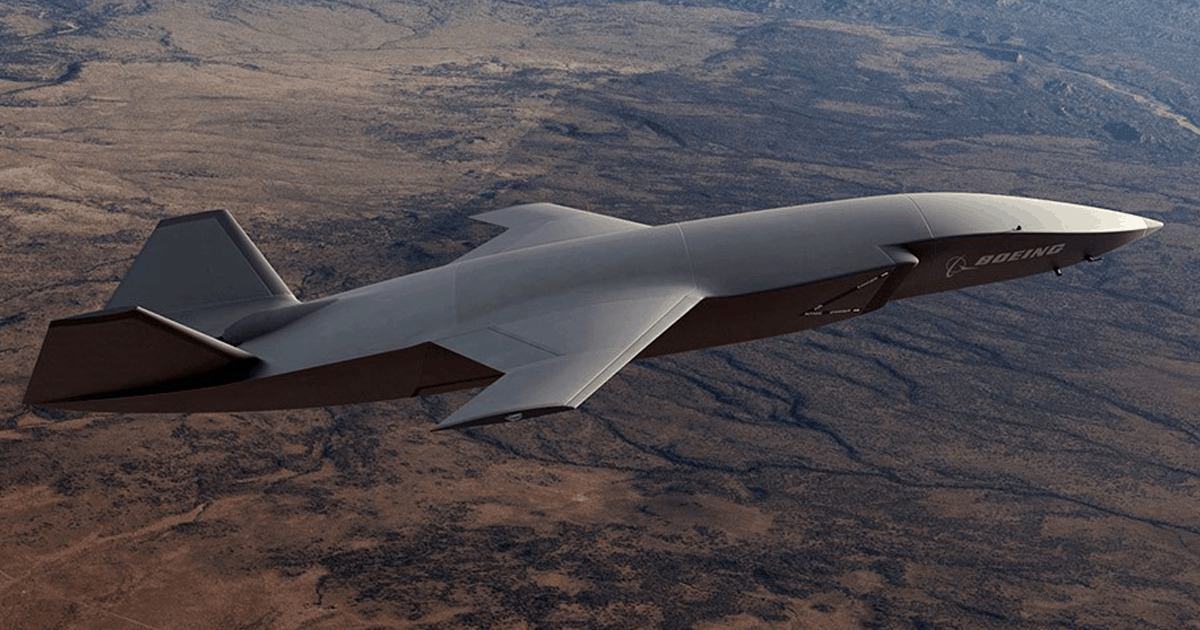

Активні розробки в області створення систем штучного інтелекту (ШІ) привели до того, що розробники починають поступово впроваджувати такі системи в озброєння і військову техніку.

Зокрема, розробляються системи, що дозволяють безпілотникам автоматично виявляти та виділяти пріоритетні цілі, або дронам виконувати роль ведених для пілотованих літальних апаратів.

Ведуться і розробки систем ШІ, здатних розшифровувати радіопередачі.

У майбутніх військових розробках штучний інтелект буде мати все більше значення.

У майбутніх військових розробках штучний інтелект буде мати все більше значення.

Активне впровадження систем штучного інтелекту в озброєння і військову техніку викликає безліч питань етичного характеру.

Зокрема, не ясно, наскільки правомірно застосовувати у війні автономні системи озброєння і яку загрозу вони представляють для мирного населення.

За оцінкою Комітету з юридичних питань Європарламенту, автономні системи озброєння можна використовувати в збройних конфліктах тільки в тому випадку, якщо рішення про відкриття вогню приймає людина.

«Автономні бойові системи слід використовувати як крайній захід, і цей крок можна визнати законним, тільки якщо ними керує людина, оскільки саме людина повинна робити вибір між життям і смертю», – йдеться в доповіді комісії.

Людина завжди повинна мати можливість внести коректування в дії автономних бойових систем, зупинити їх роботу або зовсім деактивувати такі системи в разі непередбачених обставин.

Людина завжди повинна мати можливість внести коректування в дії автономних бойових систем, зупинити їх роботу або зовсім деактивувати такі системи в разі непередбачених обставин.

При цьому повинні дотримуватися умови, при яких, в разі необхідності, можна буде точно ідентифікувати людини, яка керувала автономними бойовими системами.

Це необхідно, наприклад, на випадок пошуку винних в незаконному застосуванні зброї.

Етичні принципи.

На початку 2020 року американське міністерство оборони сформулювало п’ять етичних принципів використання систем штучного інтелекту у військових цілях:

- Відповідальність. Військовий персонал повинен з належною увагою оцінювати дії ШІ, залишаючись повністю відповідальним за розробку, розгортання і використання систем штучного інтелекту;

- Неупередженість. Міністерство оборони США має робити кроки для мінімізації небажаних відхилень в можливостях систем ШІ;

- Відстеження. Військові системи ШІ та їх можливості повинні розроблятися і розвиватися таким чином, щоб персонал мав належний рівень розуміння технології, процесів розробки та методів застосування. Для військового персоналу повинні бути доступні методології, дані й документація, що належить до використовуваних систем штучного інтелекту;

- Надійність. Можливості військових систем ШІ повинні бути однозначними, чітко сформульованими. Безпека та ефективність таких можливостей повинні перевірятися випробуваннями та підтверджуватися протягом усього терміну служби;

- Підпорядкування. Військові системи штучного інтелекту повинні повністю виконувати призначені для них завдання, але військові повинні мати можливість виявляти та запобігати небажаним наслідкам використання штучного інтелекту. Військові також повинні мати можливість виводити з бою або вимикати системи ШІ у яких були помічені відхилення в роботі.

Незадовго до оприлюднення етичних принципів використання систем штучного інтелекту начальник Об’єднаного центру ШІ США генерал-лейтенант Джек Шенехен заявив, що військові не стануть оснащувати системами ШІ центри управління стратегічним озброєнням.

За його словами, за запуски балістичних ракет завжди відповідатимуть люди, тому що рішення про застосування зброї масового ураження має бути прерогативою виключно людини.

#інтелект #зброя #людина #роботи #